一、缘起

大家在群里提的最多的事情是想在2026.4.17以后继续使用iflow cli,原因无非2点

- iflow cli用顺手了,有感情了

- iflow cli下边积累了很多的自建skills、mcp、subcommand、subagent、sdk调用(ACP模式、桥接模式),不是能迁移到qoder cli的,许多功能qoder cl不支持或者支持不完善

二、解决办法

- 调用第三方API,例如qwen3.5、glm-4.7,就是要花钱了

- 调用本地部署的ollama (ollama 也有一定量的免费cloud模型可用)、llama-server(llama.cpp里边的服务程序)

三、iflow cli第三方key配置

-

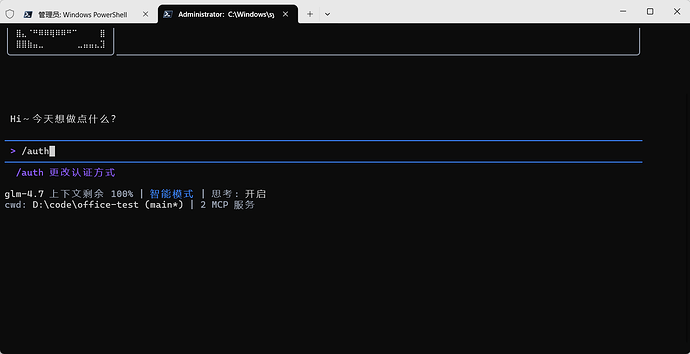

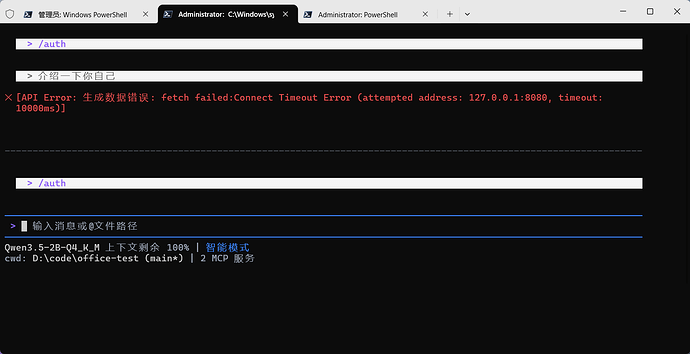

在iflow cli中执行认证命令 /auth

-

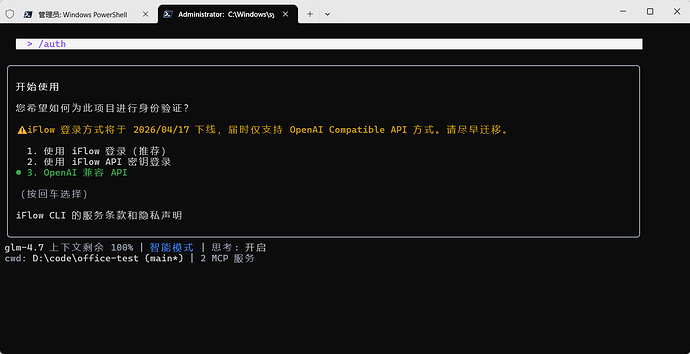

选中 “3.OpenAI 兼容 API”

-

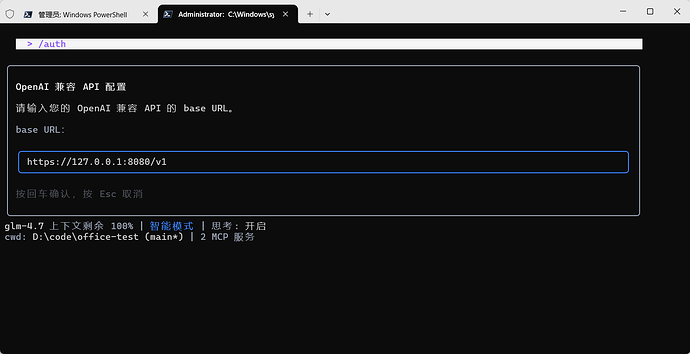

填写 API base URL,我填的是我本地的llama-server地址:http://127.0.0.1:8080/v1

-

接下来回车输入api密钥,我只开了本机调用,没有设置密钥所有随便输入一个,例如:cpp

-

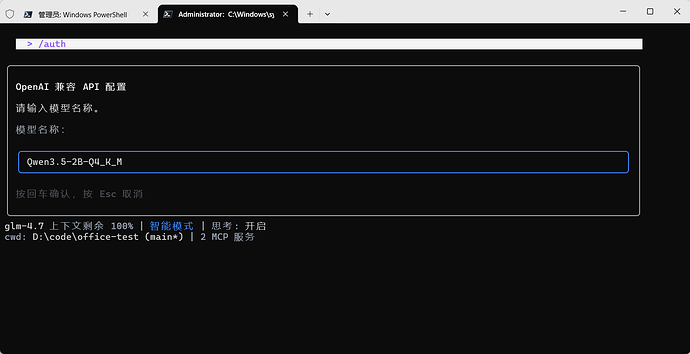

回车,接下来输入模型名称Qwen3.5-2B-Q4_K_M;也就是gguf文件名去掉.gguf后缀,我的笔记本性能一般还没有好的独立显卡,就只能跑2B、4B模型了

-

就这样配置完成;如果你是ollama或者第三方api key,配置过程也一样简单;这里第一遍没过是踩了一个坑:第三方的api key都是https的,本地自己运行的是http的,第一遍填错了,所以报错了

1 个赞

尝试配置了一下gitcode

API base URL:https://api-ai.gitcode.com/v1

API key:naaVmyWkK5NZHMx117vcSMxY

models:zai-org/GLM-5

API key:naaVmyWkK5NZHMx117vcSMxY 是试用的key,可以换成自己的key,每天有2M的免费token额度

原来要这么配置,我看有人发的说有点卡。想了下,还是续费一下ali的code plan,用起来还行。

哦还是可以通过/model来改,但是需要手动输入模型名称。

也可以在~/.iflow/settings.json里直接修改,不过没人这么蛋疼吧

感觉速度还行,不卡,我用的lite套餐,一般用qwen3.5-plus.

我看都说阿里的,qwen3.5plus不卡,用其他的模型就比较卡,不知道现在怎么样

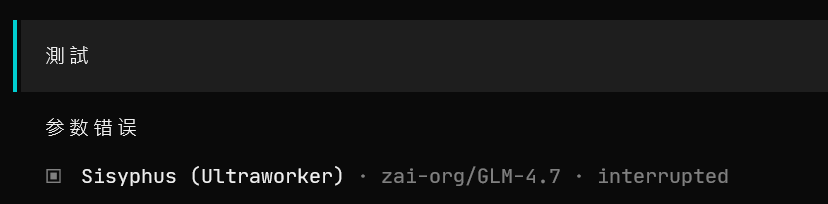

opencode 能用gitcode 嗎? 都失敗

"provider": {

"gitCode": {

"npm": "@ai-sdk/openai-compatible",

"name": "GitCode",

"options": {

"baseURL": "https://api-ai.gitcode.com/v1",

"apiKey": " "

},

"models": {

"zai-org/GLM-4.7": {

"name": "GLM-4.7"

}

}

}

}