iFlow 停服不停活 — 第三方模型全面增强补丁

iFlow 停服不停活 — 第三方模型全面增强补丁

iFlow CLI 停服了,但我的终端 AI 助手还要继续跑。

一句话总结

给 iFlow CLI 打了 15+ 个补丁,让它在停服后依然能流畅对接任意 OpenAI 兼容 API,甚至还比原生更好用。

已实现

已实现

流式输出

- 非官方支持流式输出,丝滑般顺畅体验感极强

- 修复了流式中途不停止的 bug(finish_reason 条件过滤)

- 思考模式(reasoning_content)平滑渲染,不再碎片化

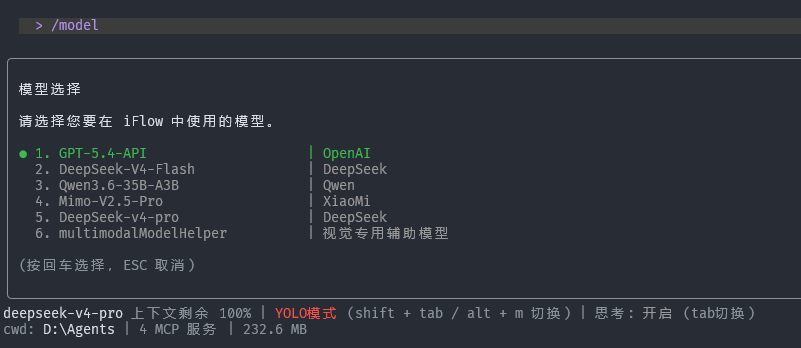

/model 模型切换

- 从

~/.iflow/models.json读取自定义模型列表 - 切换模型时自动同步:

modelName → apiKey → baseUrl → tokensLimit → supportsImages → supportsReasoning,无需手动改 settings.json - 与原生/model一模一样,不重启保留上下文,自动加载模型上下文长度、推理模式、多模态模式

- 配置文件采用腾讯Codebuddy接入第三方模型的方式,具体配置详细说明参考官方文档https://www.codebuddy.cn/docs/cli/models

多模态图片识别

- 当前模型不支持图片时,自动从 models.json 查找视觉辅助模型

- 视觉模型用自己的 url/apiKey,不和主模型混用

- 零配置 — 只要 models.json 里标个

"name": "multimodalModelHelper"就行 - 建议第三方模型即使支持多模态,也配置

"supportsImages": false,调用免费的Qwen多模态小模型速度又快又省Token, 小模型会自动把图片解析文字后自主发给主模型使用

DeepSeek / 第三方兼容

- 深度适配

DeepSeek思考模式,修复reasoning_content问题 content=null修复(tool_calls 存在时)- thinking 模型自动检测(deepseek / reasoning / thinking 关键词)

- countTokens 回退解析(Gemini 格式 contents 结构)

上下文压缩

- 第三方模型被动压缩 → 主动压缩(80% 阈值触发)

- tokensLimit 根据模型自动设置

重试与稳定性

- 修复

tool_calls被误报为"格式错误的函数调用"的 bug

配置示例

配置示例

在 ~/.iflow/models.json 里:

{

"models": [

{

"id": "deepseek-v4-pro",

"name": "DeepSeek V4 Pro",

"vendor": "DeepSeek",

"url": "https://api.deepseek.com/v1",

"apiKey": "sk-xxx",

"maxInputTokens": 100000,

"supportsImages": false,

"supportsReasoning": true

},

{

"id": "qwen3.5-vl",

"name": "multimodalModelHelper",

"vendor": "视觉专用辅助模型",

"url": "https://api.modelscope.cn/v1",

"apiKey": "ms-xxx",

"maxInputTokens": 131072,

"supportsImages": true

}

]

}

然后 /model 就能切换了。

计划中

计划中

- 流式响应中断后的断点续传

- 第三方模型 429 时的自动降级切换

- settings.json 暴露重试参数(次数/退避/超时)

- 轻量级的CAP功能集成,支持负载均衡多个中转站榨干Token

- 工具调用并发优化

为什么还要折腾

为什么还要折腾

iFlow 的原生体验确实好 — Ink/React 终端 UI、Agent 架构、MCP 工具链、上下文压缩。停服了可惜。

好在它支持 OPENAI_COMPATIBLE 认证模式,只要把 API 格式对齐,第三方模型也能跑出原生的体验。15 个补丁打下来,日常编码够用了。

还有个重要原因我深度使用很多CLI工具,![]() iflow是最懂人话的,具体点应该是最懂中文指令,

iflow是最懂人话的,具体点应该是最懂中文指令,![]() 他说唯一我使用能深度跑任务10多个小时不停迭代不断的CLI。

他说唯一我使用能深度跑任务10多个小时不停迭代不断的CLI。

免责声明

本项目为非官方社区工具,与 iFlow 官方团队无任何关联。使用本工具修改 iflow.js 可能违反 iFlow 的使用条款,且 iFlow 更新后补丁可能失效。使用本工具产生的任何问题(包括但不限于数据丢失、API 费用异常、服务中断),由使用者自行承担。请确保你理解本工具的工作原理后再使用。

致谢

- iFlow CLI — 本工具所修补的原始项目

如果你也在用停服后的 iFlow 接第三方模型,欢迎交流踩坑经验

第一版采用网盘方式论坛内部使用分享反馈,后续github持续更新

先备份原始iflow.js再替换我的文件,路径C:\Users\用户\AppData\Roaming\npm\node_modules@iflow-ai\iflow-cli\bundle

链接:123云盘

提取码:Tfa4