atomcode-auth 插件下载:: 夸克网盘分享

为什么不开源呢:我们悄悄地用 ,开源→用得人多了就会变卡 && 反正都是给他们提供训练数据,只是换了一种方式。

使用方式:

1、下载解压

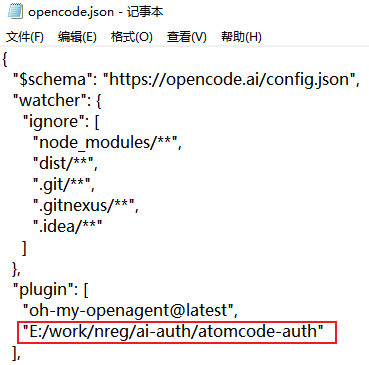

2、%USERPROFILE%\.config\opencode\opencode.json 配置文件中增加以下配置:写解压后的路径

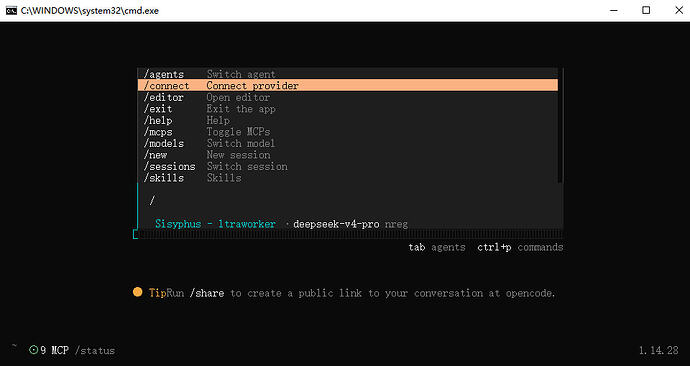

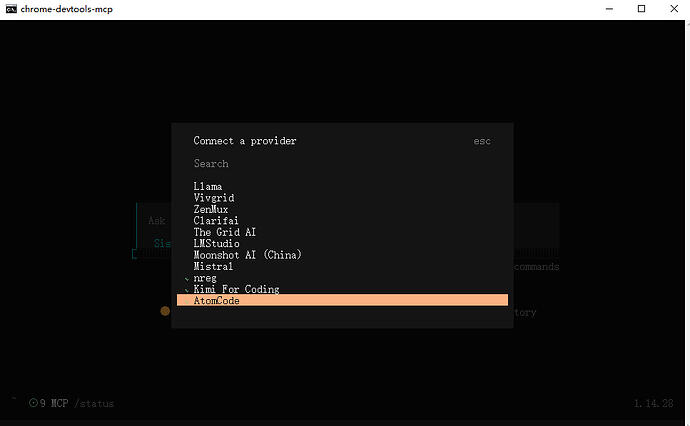

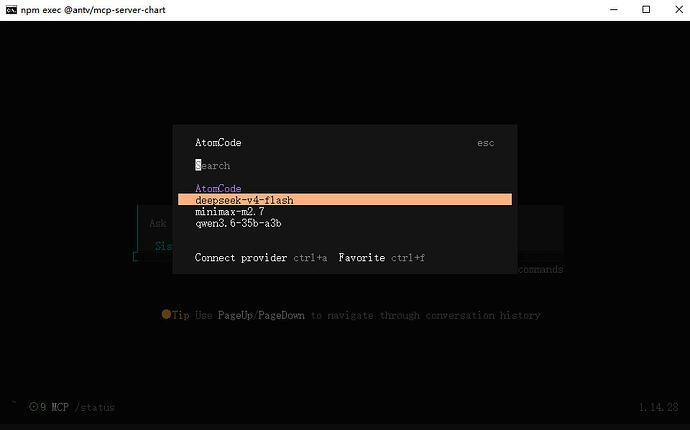

授权登录:cli用户直接命令行输入 opencode 回车,gui用户命令行输入 opencode-cli 回车,按图操作

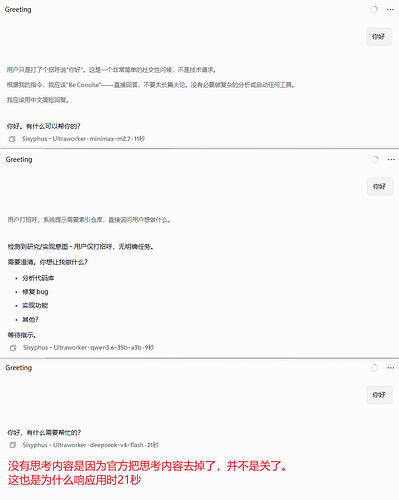

测试情况:

修了官方哪些问题?:

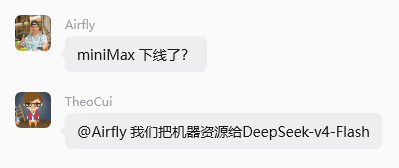

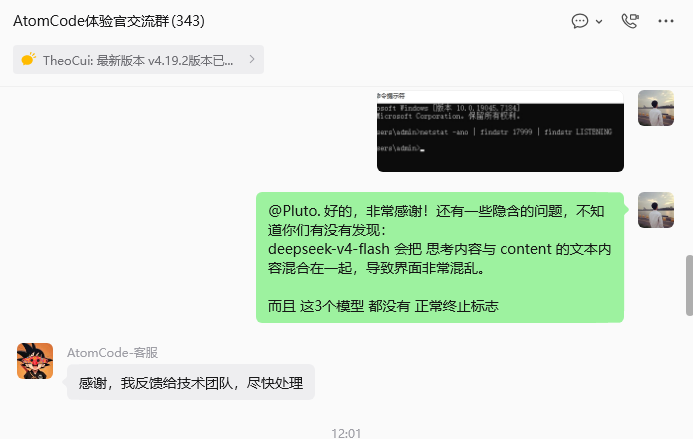

1、向官方反应了 deepseek的未正确回传 reasoning_content 的问题后,官方给关了思考内容,但没关思考。

2、修复3个模型SSE流式都不会正确终止的问题,官方修复后,插件不会走修复逻辑

注:免费使用 deepseek-v4-pro 可以使用 NVIDIA 的:

baseUrl:https://integrate.api.nvidia.com/v1

apiKey 申请:Try NVIDIA NIM APIs

| 模型id | 模型别名 | 描述 | 最大输入 | 最大输出 | 最大思维链长度 | 上下文 | 类型 | TPS |

|---|---|---|---|---|---|---|---|---|

| deepseek-ai/deepseek-v4-pro | deepseek-v4-pro | Agentic Coding 模型,据评测反馈使用体验优于 Sonnet 4.5,交付质量接近 Opus 4.6 非思考模式,但仍与 Opus 4.6 思考模式存在一定差距。针对 Claude Code 、OpenClaw、OpenCode、CodeBuddy 等主流的 Agent 产品进行了适配和优化。 | - | 384k | - | 1m | 文本 | 每秒26 tokens |