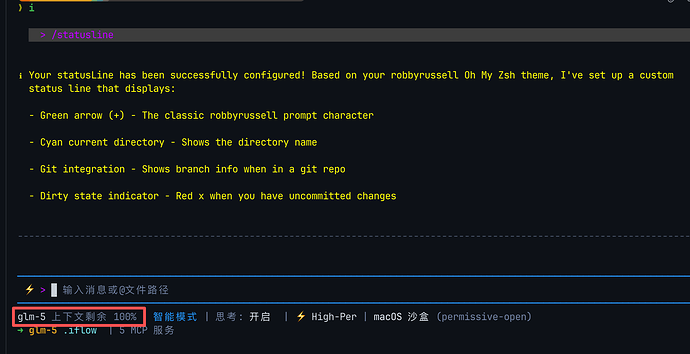

不用 glm-5 就行,这几天 glm-5 用着用着就这样,glm-4.7 / minimax-m2.5 倒是没遇到过

1 个赞

没遇到过

刚刚好像是有点问题,我问了一直在等待都没有反应。重启了升级了一下好了

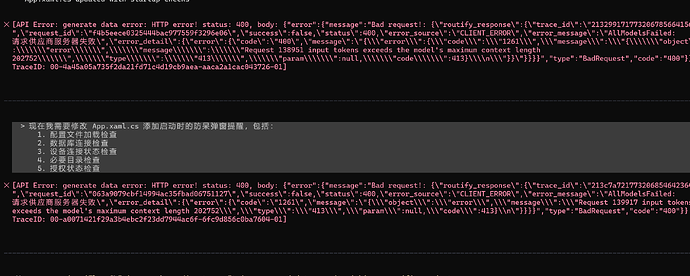

仔细看报错

Request 138951 input tokens exceeds the model’s maximum context length 202752

请求 138951 个输入标记超过了模型的最大上下文长度 202752

1.手动执行/compress压缩上下文

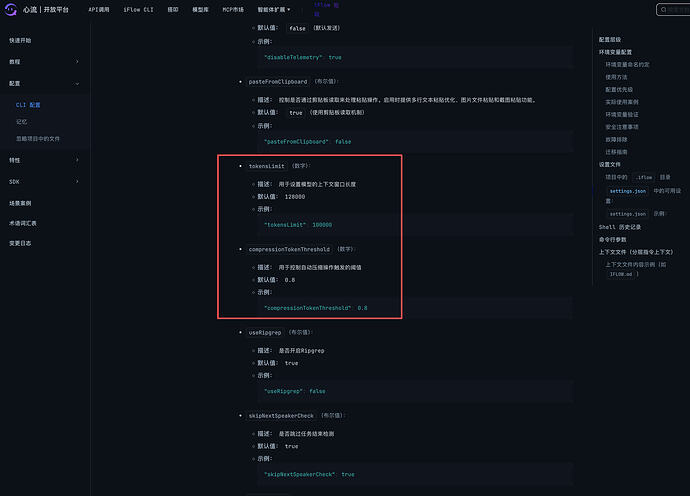

2.配置~/.iflow/settings.json中的参数tokensLimit、compressionTokenThreshold

参考文档 CLI 配置 | 心流开放平台

1 个赞

这是上下文超了吧

input 139917 / maxium 202752, 这个是context超长了吧.

输入太长,没有来得及auto compact吧.

glm5这几天用的人多,所以高峰使用有点慢

然后就是超长问题,参考楼上的办法改下压缩阈值也能解决,这个模型长度和触发自动压缩的位置很巧合在同一个数值范围

1 个赞