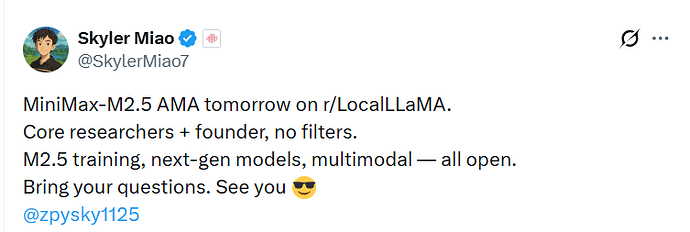

刚从 X (原 Twitter) 刷到重磅消息:MiniMax 官方核心团队(核心研究员 + 创始人)即将在 Reddit 的 r/LocalLLaMA 版块开启 AMA (Ask Me Anything) 活动!

==========================================

![]() AMA 核心看点预警

AMA 核心看点预警

==========================================

● 官方明确提到的交流主题包括:M2.5 的训练细节、**Next-gen models(下一代模型)** 以及大家最期待的 **Multimodal(多模态)能力**!

● 这意味着 MiniMax 在 M2.5 这种纯文本/代码强模型之后,原生多模态大招已经提上日程了。

==========================================

![]() 为什么 MiniMax 的多模态值得期待?

为什么 MiniMax 的多模态值得期待?

==========================================

作为国内最早深耕生成式 AI 的厂商之一,MiniMax 在多模态领域其实早就“肌肉满满”:

● 语音背景:他们的语音模型(如海螺 AI、音色复刻)一直处于国内顶尖水平。

● 视频实力:此前的视频生成模型在空间连贯性和画面质感上也非常亮眼。

当这种顶级的音视频生成能力与 M2.5 级别的逻辑能力深度融合,MiniMax 的下一代原生多模态模型非常值得关注。

==========================================

![]() 讨论环节

讨论环节

==========================================

从 M2.5 对比 Kimi K2.5 等现有多模态模型的表现来看,大家觉得 MiniMax 在多模态方向上会有哪些差异化的亮点?

AMA 即将开启,大家有什么想问官方的硬核问题吗?