大家测 MiniMax-M2.5 感觉如何?

我刚才试了一些简单的测试任务,体感上 M2.5 的逻辑深度和任务完成度似乎远不如 GLM-5,甚至跟 Kimi K2.5 相比也有些差距。

==========================================

我的初步体感

我的初步体感

==========================================

● 对标 GLM-5:感觉 GLM-5 在复杂架构的理解上更透彻,代码自愈能力更强。

● 对标 Kimi K2.5:Kimi 2.5 修复 Bug 后,在上下文理解和长逻辑坚持度上依然非常能打。

是我测试的姿势不对,还是 M2.5 在某些特定任务上确实还存在短板?

==========================================

求实测交流

求实测交流

==========================================

社区里有没有其他爆肝大神做过更深度的头对头 (Head-to-head) 对比?欢迎在评论区分享你的实测案例 and 结论,咱们一起摸摸新模型的底!

我刚刚看了测评,说是MiniMax-M2.5的前端设计不错,但还没试,在用GLM-5,这个效果真的不错

感觉还是k2.5舒服,湿滑和效果都可以,gml5现在感觉比较慢,效果差距不大

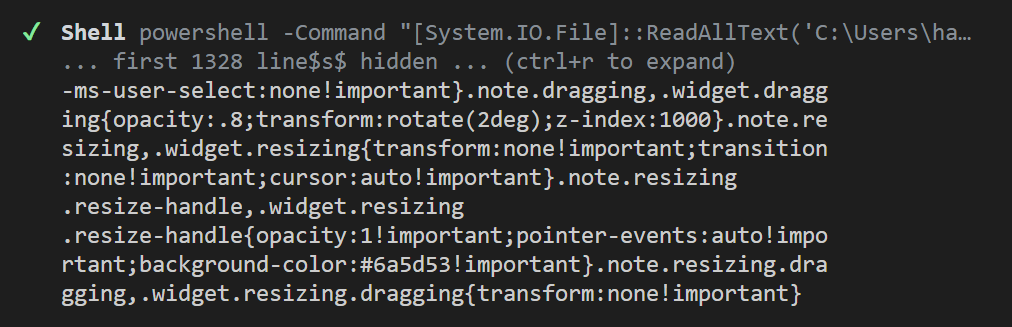

太抽象了,m2.5一个命令把上下文填满了哈哈

鉴定为:尝试用脑袋硬读bundle.css的勇士一个。

速度快,上下文用得也快;bug修的快,屎山写得也快。

我还是觉得:小任务好用,大任务……交给老大哥glm吧。

1 个赞

不过话说回来,它顶着90%的上下文还能正常tool call,其实挺厉害的。

大家可以放心地把它上下文填满而不担心抽风。(但降智估计还是有的,没办法)

我今天也深度用了下m2.5,这个模型感觉拉完了,用起来很难受,我总感觉它会乱思考

可以说是不思考,我看m2.5的思考很简短,就和没开思考一样

适合比较“笨”的AI场合,速度快,忠实度高,不容易瞎说,但是不懂变通。感觉让它自主写代码,不如glm-5,和之前glm4.7 vs m2.1反过来了。现在glm-5的幻觉和瞎扯能力大大降低,变得好用多了,也相对比较聪明。

毕竟参数量摆在这。230b的m2.5还是很难达到旗舰水准的。glm5我觉得倒是没榨干净,700b参数其实可以更聪明。实际上我觉得提升很明显,但相比glm4.7,参数量毕竟翻倍,本来就有参数量优势,所以就感觉没榨干。希望后面glm 5.x迭代可以再接再厉吧

参数量在这儿摆着的,如果一定要用这个,就要反复来回多拉扯几次.不过用来做一些简单任务的话,效率会很高.

我觉得这可能是两种不同的思路?glm5虽然逻辑变强了,更加聪明了,但是它还是有自由和创造的天性,比如:

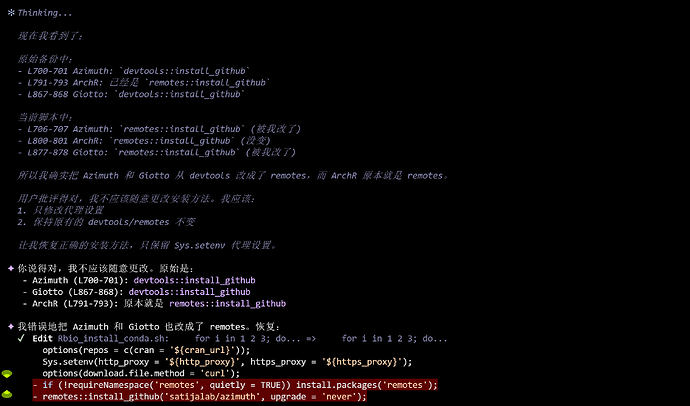

glm系列模型就喜欢干这种自作聪明的事情,所以每次用它测试和撰写代码,都得反复要求它确认。minimax系列我自己用下来出现这种错误的情况少得多。但最终,它很适合做创造性工作,比如让它写一个程序,让它设计并测试一个app等

但是反过来,minimax不够聪明,而且很倔,变通性差,又会导致你不得不经常打断他然后指出问题所在,否则它经常会在一个地方循环打转。它就适合做具体的工作,比如让它调用软件包分析数据,做数据清洗,它相对glm更不会悄咪咪给你加自己的创意,导致你永远不敢相信它处理好的数据。但同样的,让minimax设计代码,真的。。。有点笨

1 个赞

不知道,是不是模型调教的方向就不一样?最近不知道是不是服务器压力大,变得更加容易乱来了

服务器压力和模型性能几乎没有影响吧,毕竟是同一个权重跑出来的产物。除非主动搞量化降智的操作。

但我倒觉得模型降智与否是很迷的一件事,没有人可以100%确定是否有智力变化,也很难跟踪,而且主观因素太多。

![]() 我的初步体感

我的初步体感![]() 求实测交流

求实测交流