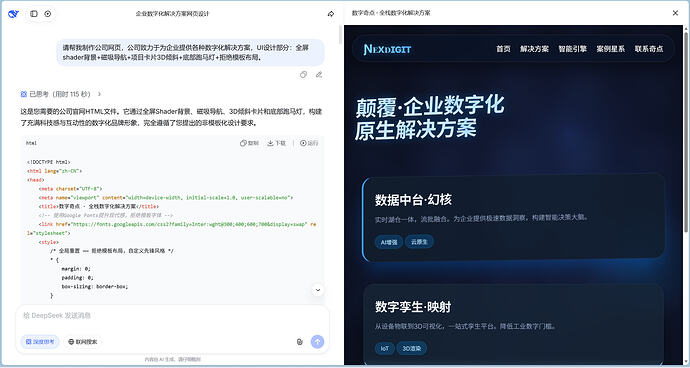

性能上感觉不是太好,网页代码比GLM 4.6略差一点。

推理的时候略微有点乱,有种到处乱想的感觉。

1 个赞

![]() 哦?v4?

哦?v4?

不是。我觉得不够聪明,感觉是小模型

V3.2灰度更新了 1m上下文 资料25年5月

现在不是3.2已经,应该是新的小模型。

期待ds把大的端上来

deepseek我记得就两个动作 一个就是1m上下文那个灰度 还有个是ORC的 只有几B的小模型

期待也没用 我不知道你那个high能不能用deepseek 我已经好久没有正常用过deepseek了 ilfow 里面 我觉得最好用的就是deepseek比GLM4.7 KIMI K2.5都强大 ,严谨一些,慢点绝对是可以接受的,如果不能接受codex早该被淘汰了 ,最近codex限免 ,有需要可以去试试 ,慢,但是好用.