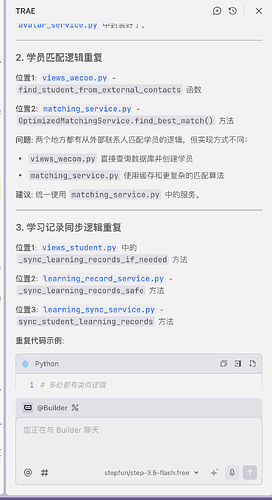

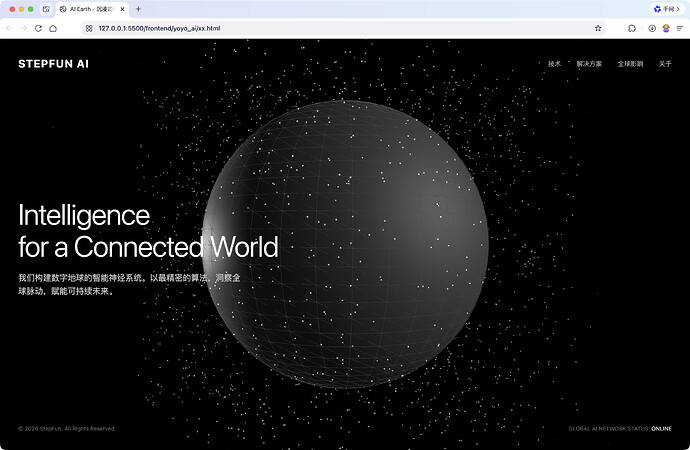

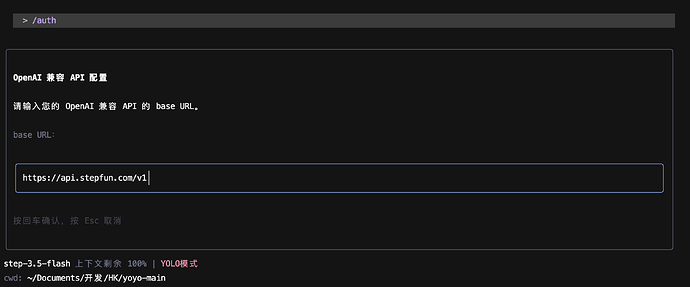

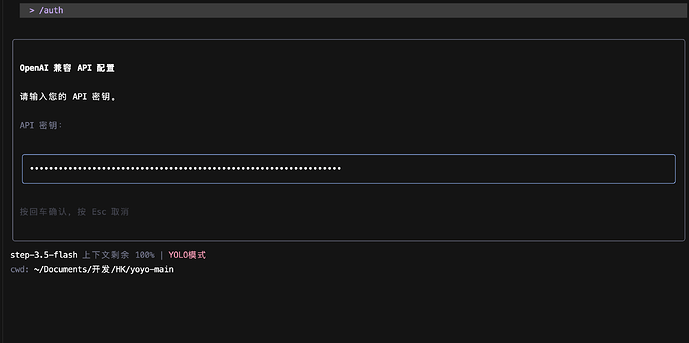

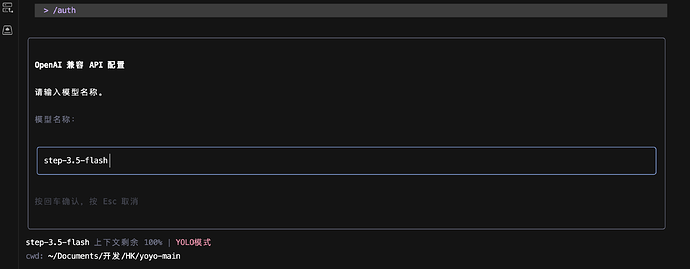

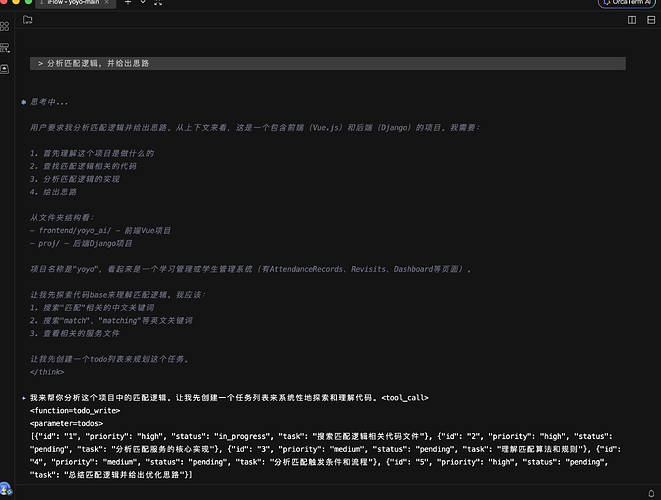

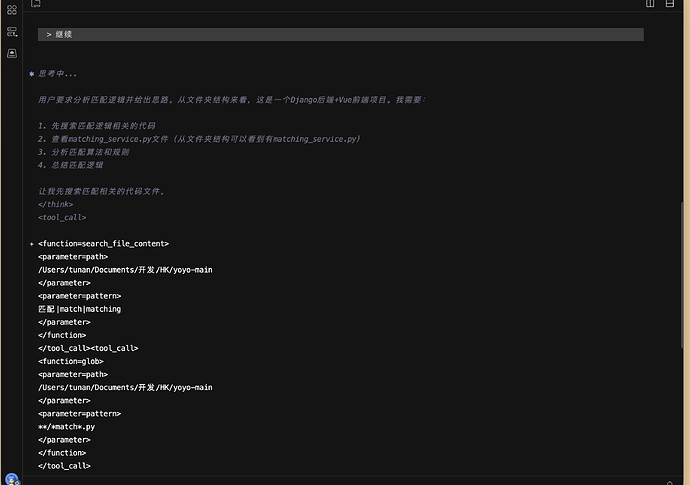

这个模型最大的感受就是快,快的离谱,但是我最开始以为只是快,因为国产模型不缺乏快的,比如longchat-flash-chat,longcat-flash-thinking-2601,hunyuan2.0,都快,但是结果差强人意,step-3.5-flash初测没有特别的感受,就是单纯的觉得快,但是多测试几次之后,我觉得从代码逻辑和前端审美(不及kimi2.5)来说都确实属于编码模型第一梯队了,这次重点测试的是后端逻辑,前端审美也附上,前端还是差点意思,工具选择是Trae,通过api的方式接入,说实话,Trae的所有模型都很慢,但是这个api接入,真的快的头皮发麻,结果也非常对,符合我的心理预期,觉得模型输出慢的可以冲!目前openrouter有限时限量的免费api体验!

| step-3.5-flash |

|---|