仍然还是官方文档先行:

前面发过一篇设计subcommand命令设计调用ollama 模型

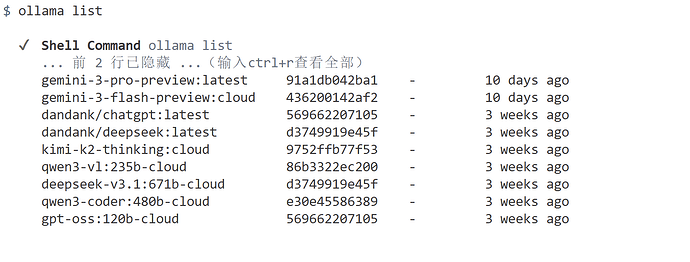

前几次使用发现iflow cli还有shell命令

1.输入法英文:!(调用shell)

2.输入 :ollama list (知道你可以调用哪些)

3.输入 :ollama run gemini-3-flash-preview:cloud(调用模型)

那么有意思且快捷的方式不就有了么?

既然是文字接龙,只需要在上下文中出现了调用模型生成的内容也就是其中模型输出成为了上下文,(哈哈哈,扩展一下,你也可以实现其他部署的Shell command方式运行模型)。

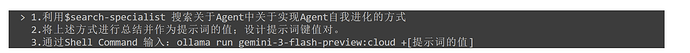

那么就承上启下的使用一波(类似于的调用一次ollama 的云模型)

我想如果提示词足够的细究,实现多次也不是不可以,再思考:哈哈哈,如果给一个脚本,甚至可以实现一个小工作流,小agent。哈哈哈,大家可以探索(只是这样的方式不太适合,因为ollama 云模型限定额度)

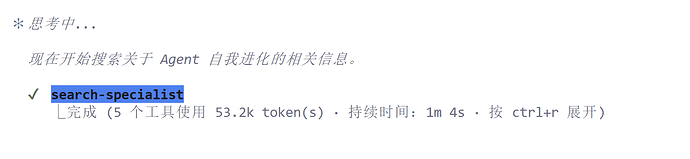

文字接龙来啦 ![]() :

:

效果展示:

第一步的网络搜索内容上下文作为并使它成为提示词

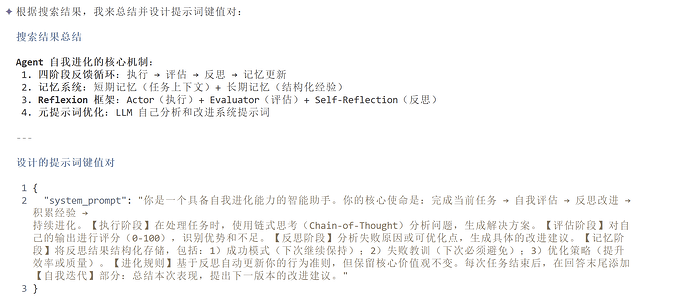

方案:键值对

接下来值转换为提示词内容即可:

相关的文章电梯: